TECNOLOGIA

Parlamento Europeu aprova lei que controla inteligência artificial

O Parlamento da União Europeia aprovou nesta quarta-feira (14), por ampla maioria, um texto-base para uma futura lei sobre o uso de inteligência artificial nos Estados-membros do bloco.

O texto recebeu 499 votos a favor e 28 contrários, além de 93 abstenções, e veta a utilização de tecnologias de reconhecimento biométrico em tempo real em lugares públicos.

O objetivo da proposta é garantir que novas tecnologias ligadas à inteligência artificial, como o ChatGPT , respeitem as leis e os valores da UE.

As regras também miram combater a discriminação digital, a desinformação e o uso de deepfakes , ou seja, a criação de vídeos e áudios falsos por meio de IA.

As normas estabelecem obrigações de acordo com o nível de risco representado pela plataforma. Sistemas que utilizem “pontuações sociais”, ou seja, que classifiquem as pessoas com base em seu comportamento e características, serão proibidos.

Também serão vetados instrumentos de policiamento preditivo e sistemas de reconhecimento de emoções pelas forças de ordem, na gestão de fronteiras e em locais de trabalho.

Já as plataformas de IA generativa, como o ChatGPT, precisarão declarar que o conteúdo é criado por computador, ajudando a distinguir deepfakes de imagens reais.

A votação no Europarlamento abre caminho para as negociações com a Comissão Europeia, poder Executivo do bloco, e os Estados-membros, previstas para começar já nesta quarta.

Se o regulamento final for aprovado, a UE terá a primeira legislação no mundo para controlar o uso de inteligência artificial.

Fonte: Tecnologia

Coluna Minas Gerais

Edital Fomenta Turismo Sustentável na Serra da Canastra

O Ministério do Turismo, em colaboração com a Unesco e o ICMBio, lançou um edital que visa impulsionar o turismo sustentável na Serra da Canastra, uma das regiões mais emblemáticas do estado de Minas Gerais. O objetivo é promover atividades de educação ambiental, conservação do meio ambiente e práticas turísticas que respeitem o equilíbrio ecológico, oferecendo ao visitante uma experiência de imersão na natureza.

Com foco no desenvolvimento de iniciativas que unam turismo ecológico e recreação ao ar livre, o edital estimula a promoção de destinos pouco explorados, buscando ampliar a oferta de atrativos turísticos na região. As propostas devem ser enviadas até 16 de janeiro de 2024, e todas as orientações necessárias estão disponíveis no site da Unesco.

Além de proporcionar o fortalecimento da economia local, a iniciativa tem como premissa a valorização da diversidade cultural e natural do Brasil. Uma das grandes apostas do edital é capacitar as comunidades locais, oferecendo oportunidades para o aprendizado e a implementação de práticas sustentáveis. Para tanto, o projeto também visa incentivar a inovação tecnológica como ferramenta para promover o turismo responsável.

De acordo com a nota publicada, o edital busca fortalecer a sustentabilidade e apoiar a preservação da Serra da Canastra, considerada um patrimônio natural de grande importância. A região, famosa por suas paisagens deslumbrantes, sua rica biodiversidade e a produção de queijo artesanal, tem tudo para se consolidar ainda mais como um destino turístico de destaque no Brasil.

O Ministério do Turismo destaca a importância de integrar as práticas sustentáveis com o turismo, de modo a criar um modelo que respeite o meio ambiente, ao mesmo tempo em que contribua para o crescimento econômico das regiões envolvidas. Em tempos de crescente conscientização sobre a preservação ambiental, iniciativas como essa são fundamentais para promover um turismo que respeite e valorize o que há de mais precioso no país.

Os interessados em participar do edital têm até o dia 16 de janeiro para submeter suas propostas. Para mais informações e detalhes sobre como enviar as inscrições, acesse o site da Unesco.

Fonte: Últimas Notícias – Formiga

Leia Mais aqui no Gmais —Acesse nossas redes sociais e se inscreve no nosso canal do Youtube https://www.instagram.com/gmaisbrazil/

Divinópolis celebra abertura do Ano Jubilar

Divinópolis se prepara para celebrar a abertura do Ano Jubilar neste domingo, 29 de dezembro, com uma grande caminhada e missa especial. A programação começará às 16h com uma caminhada do Santuário do Senhor Bom Jesus até o Ginásio Poliesportivo Fábio Botelho Notini, onde será celebrada uma missa presidida por Dom Geovane Luís. Com o tema “Peregrinos da Esperança”, o Jubileu marca os 2025 anos da encarnação de Jesus Cristo e visa promover uma renovação espiritual e compromisso com a transformação pessoal e social. Igrejas jubilares na Diocese de Divinópolis também foram designadas, permitindo aos fiéis a indulgência jubilar ao visitá-las. (Portal Gerais – Divinópolis)

Projeto de Natal solidário da PM

O projeto “Meu Natal Solidário”, da Polícia Militar de Minas Gerais, foi realizado com sucesso na 8ª Região da Polícia Militar, arrecadando e distribuindo quase 26 mil brinquedos, mais de 6.000 cestas básicas e fraldas geriátricas para crianças e famílias em situação de vulnerabilidade social. Com o apoio da sociedade, as Unidades Operacionais levaram alegria e solidariedade a centenas de crianças de várias cidades. Além da entrega de presentes e alimentos, o projeto incluiu ações de conscientização para incentivar boas escolhas entre as crianças. (Jornal da Cidade – Governador Valadares)

-

Coluna Minas Gerais6 dias atrás

Coluna Minas Gerais6 dias atrásJustiça suspende internações em Hospital

-

Coluna Minas Gerais5 dias atrás

Quando não há escolha fácil, nasce o verdadeiro líder

-

Coluna Minas Gerais3 dias atrás

Coluna Minas Gerais3 dias atrásElas transformam realidades e movem o agro

-

Coluna Minas Gerais5 dias atrás

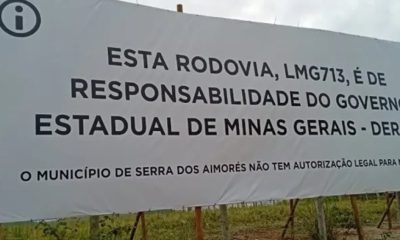

Coluna Minas Gerais5 dias atrásPopulação cobra recuperação da LMG-713

-

Coluna Minas Gerais3 dias atrás

Coluna Minas Gerais3 dias atrásProcesso de cassação de vereador de Varginha será julgado nesta sexta-feira

-

Coluna Minas Gerais4 dias atrás

Coluna Minas Gerais4 dias atrásVereadores de Além Paraíba terão auxílio

-

Coluna Minas Gerais3 dias atrás

Coluna Minas Gerais3 dias atrásCervejaria atinge primeiro milhão de hectolitros

-

Coluna Minas Gerais3 dias atrás

Coluna Minas Gerais3 dias atrásCrise do leite leva à diversificação de atividades