TECNOLOGIA

Polícia de cidade dos EUA pode usar robôs com ‘licença para matar’

A cidade de São Francisco, Estados Unidos, por meio da sua câmara de supervisores, aprovou o uso de robôs armados pela polícia. Agora, o Departamento de Polícia de São Francisco (SFPD, na sigla em inglês) poderá usar o equipamento para matar ou ferir suspeitos em situações de perigo à vida. Entre as polêmicas do caso, está a escolha da arma.

A proposta para o uso do “Robocop” garante que ele só será usado como último recurso. O principal exemplo usado em favor do robô foi o caso de um atirador que matou cinco policiais e dois civis em Dallas, Texas. A polícia da cidade texana usou um robô antibombas para levar uma bomba até o local onde o atirador estava.

Robô policial, o drone amigo da vizinhança

Se você já assistiu The Wire, deve lembrar da cena em que James McNutty, em um momento de epifania comenta com um de seus colegas que sente falta da época do “policial da vizinhança”, que conhecia os moradores pelo nome.

A chegada do robô policial com “permissão para matar” leva aos cidadãos de São Francisco algo que eles só veem pelo noticiário: drones usados em guerras. Claro, dada as devidas proporções. Não estamos falando de um MQ-9 Reaper com míssil Hellfire, mas sim de um robô com uma granada ou escopeta.

Conforme explica o Ars Technica, alguns robôs antibombas usam escopeta para desarmar a bomba. Robôs armados não estão longe da população, mas o seu uso em operações de combate da polícia ainda é novidade.

A SFPD usa o robô Talon para situações antibomba. O robô é fabricado pela QinetiQ, empresa que também desenvolveu o MAARS, a versão “Rambo” do Talon.

Um dos argumentos contrários ao uso dos robôs policiais é que não há necessidade da instalação de armas letais, pois a vida dos policiais não estará em risco — a operação dos robôs será feita remotamente.

No caso em Dallas, ocorrido em 2016, a polícia usou o robô adaptado como último recurso — inclusive foi especulado que a bomba usada era do kit de desarme. Afinal, cinco policiais e dois civis foram mortos. Para garantir o seu uso como última medida, a legislação de São Francisco garantirá que somente um número limitado de oficiais de alto escalão autorizem o uso do robô como força letal.

Bombas aumentam risco de efeitos colaterais

O uso de um robô não garantirá o fim das falhas nas abordagens — ele ainda será controlado remotamente. Além disso, a opção da SFPD é, em um primeiro momento, usar robôs-bombas — que aumenta o risco de acertar civis.

O problema de efeitos colaterais com drones levou as Forças Armadas a desenvolver o Hellfire R9X, míssil antipessoal sem nenhum explosivo. Se o objetivo desses “robocops” são finalizar uma situação extrema sem colocar em risco a vida de policiais e civis, o uso de armas não letais nos robôs também é possível. Mesmo que alguns estados americanos tenham pena de morte, o papel da polícia ainda é garantir o devido processo legal.

Fonte: IG TECNOLOGIA

Coluna Minas Gerais

Edital Fomenta Turismo Sustentável na Serra da Canastra

O Ministério do Turismo, em colaboração com a Unesco e o ICMBio, lançou um edital que visa impulsionar o turismo sustentável na Serra da Canastra, uma das regiões mais emblemáticas do estado de Minas Gerais. O objetivo é promover atividades de educação ambiental, conservação do meio ambiente e práticas turísticas que respeitem o equilíbrio ecológico, oferecendo ao visitante uma experiência de imersão na natureza.

Com foco no desenvolvimento de iniciativas que unam turismo ecológico e recreação ao ar livre, o edital estimula a promoção de destinos pouco explorados, buscando ampliar a oferta de atrativos turísticos na região. As propostas devem ser enviadas até 16 de janeiro de 2024, e todas as orientações necessárias estão disponíveis no site da Unesco.

Além de proporcionar o fortalecimento da economia local, a iniciativa tem como premissa a valorização da diversidade cultural e natural do Brasil. Uma das grandes apostas do edital é capacitar as comunidades locais, oferecendo oportunidades para o aprendizado e a implementação de práticas sustentáveis. Para tanto, o projeto também visa incentivar a inovação tecnológica como ferramenta para promover o turismo responsável.

De acordo com a nota publicada, o edital busca fortalecer a sustentabilidade e apoiar a preservação da Serra da Canastra, considerada um patrimônio natural de grande importância. A região, famosa por suas paisagens deslumbrantes, sua rica biodiversidade e a produção de queijo artesanal, tem tudo para se consolidar ainda mais como um destino turístico de destaque no Brasil.

O Ministério do Turismo destaca a importância de integrar as práticas sustentáveis com o turismo, de modo a criar um modelo que respeite o meio ambiente, ao mesmo tempo em que contribua para o crescimento econômico das regiões envolvidas. Em tempos de crescente conscientização sobre a preservação ambiental, iniciativas como essa são fundamentais para promover um turismo que respeite e valorize o que há de mais precioso no país.

Os interessados em participar do edital têm até o dia 16 de janeiro para submeter suas propostas. Para mais informações e detalhes sobre como enviar as inscrições, acesse o site da Unesco.

Fonte: Últimas Notícias – Formiga

Leia Mais aqui no Gmais —Acesse nossas redes sociais e se inscreve no nosso canal do Youtube https://www.instagram.com/gmaisbrazil/

Divinópolis celebra abertura do Ano Jubilar

Divinópolis se prepara para celebrar a abertura do Ano Jubilar neste domingo, 29 de dezembro, com uma grande caminhada e missa especial. A programação começará às 16h com uma caminhada do Santuário do Senhor Bom Jesus até o Ginásio Poliesportivo Fábio Botelho Notini, onde será celebrada uma missa presidida por Dom Geovane Luís. Com o tema “Peregrinos da Esperança”, o Jubileu marca os 2025 anos da encarnação de Jesus Cristo e visa promover uma renovação espiritual e compromisso com a transformação pessoal e social. Igrejas jubilares na Diocese de Divinópolis também foram designadas, permitindo aos fiéis a indulgência jubilar ao visitá-las. (Portal Gerais – Divinópolis)

Projeto de Natal solidário da PM

O projeto “Meu Natal Solidário”, da Polícia Militar de Minas Gerais, foi realizado com sucesso na 8ª Região da Polícia Militar, arrecadando e distribuindo quase 26 mil brinquedos, mais de 6.000 cestas básicas e fraldas geriátricas para crianças e famílias em situação de vulnerabilidade social. Com o apoio da sociedade, as Unidades Operacionais levaram alegria e solidariedade a centenas de crianças de várias cidades. Além da entrega de presentes e alimentos, o projeto incluiu ações de conscientização para incentivar boas escolhas entre as crianças. (Jornal da Cidade – Governador Valadares)

-

Coluna Minas Gerais6 dias atrás

Coluna Minas Gerais6 dias atrásJustiça suspende internações em Hospital

-

Coluna Minas Gerais5 dias atrás

Quando não há escolha fácil, nasce o verdadeiro líder

-

Coluna Minas Gerais4 dias atrás

Coluna Minas Gerais4 dias atrásElas transformam realidades e movem o agro

-

Coluna Minas Gerais4 dias atrás

Coluna Minas Gerais4 dias atrásProcesso de cassação de vereador de Varginha será julgado nesta sexta-feira

-

Coluna Minas Gerais5 dias atrás

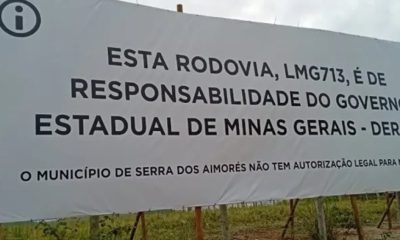

Coluna Minas Gerais5 dias atrásPopulação cobra recuperação da LMG-713

-

Coluna Minas Gerais4 dias atrás

Coluna Minas Gerais4 dias atrásVereadores de Além Paraíba terão auxílio

-

Coluna Minas Gerais3 dias atrás

Coluna Minas Gerais3 dias atrásCervejaria atinge primeiro milhão de hectolitros

-

Coluna Minas Gerais3 dias atrás

Coluna Minas Gerais3 dias atrásCrise do leite leva à diversificação de atividades